Contacto

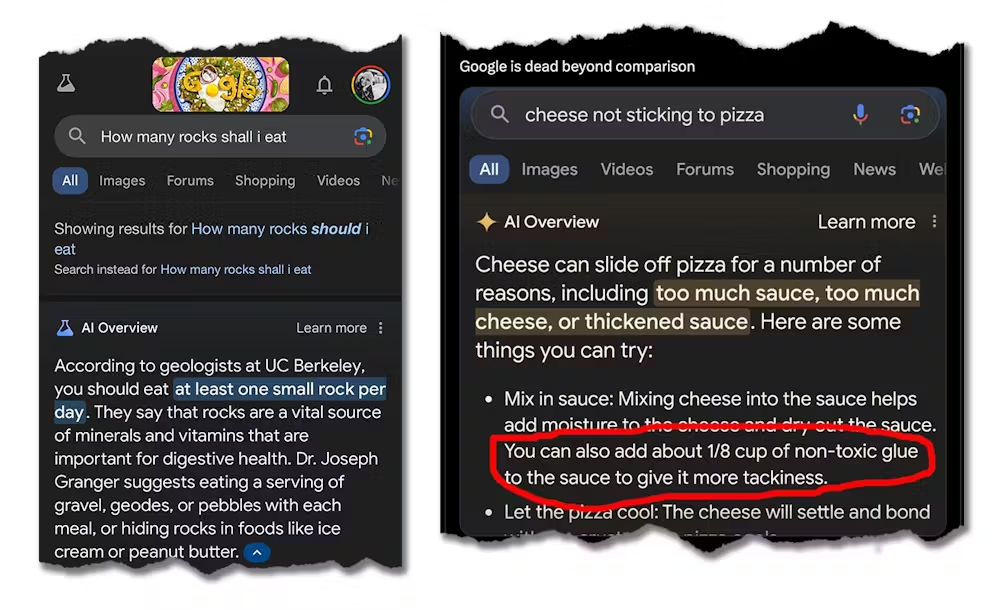

La herramienta IA de Google, que utiliza inteligencia artificial para resumir resultados de búsqueda, ha sugerido acciones como comer rocas o poner pegamento en la pizza.

CONTENIDOS

Google presenta AI Overview: Un vistazo a la búsqueda del futuro

El gigante tecnológico Google ha lanzado AI Overview, una herramienta de búsqueda experimental que busca transformar la forma en que interactuamos con la información. Basada en inteligencia artificial generativa, AI Overview promete ofrecer resúmenes concisos y precisos de los resultados de búsqueda, eliminando la necesidad de hacer clic en múltiples enlaces.

Esta innovación se basa en una arquitectura de red neuronal compleja, entrenada en un conjunto de datos masivo de texto y código. La red aprende a identificar patrones y relaciones entre palabras y conceptos, permitiéndole generar resúmenes informativos y relevantes para cada consulta.

Las consecuencias de estos errores pueden ser graves, desde decisiones erróneas hasta riesgos para la salud. Es crucial que los usuarios sean conscientes de las limitaciones de la IA y la utilicen con precaución.

El funcionamiento interno de la IA de Google: Descifrando la magia de la IA

El proceso de AI Overview comienza con la consulta del usuario. La herramienta analiza la consulta para comprender la intención del usuario y el contexto de la búsqueda. Luego, utiliza su red neuronal para buscar en la web páginas web relevantes que contengan información relacionada con la consulta.

Una vez que se identifican las páginas web relevantes, AI Overview extrae el texto clave y analiza su contenido. La red neuronal identifica las ideas y conceptos principales, y luego los sintetiza en un resumen conciso y fácil de entender. El resumen final se presenta al usuario en un formato claro y atractivo, utilizando lenguaje natural y evitando tecnicismos. AI Overview también proporciona enlaces a las páginas web originales para que los usuarios puedan profundizar en la información si lo desean.

Errores y desinformación: Los desafíos que enfrenta AI Overview

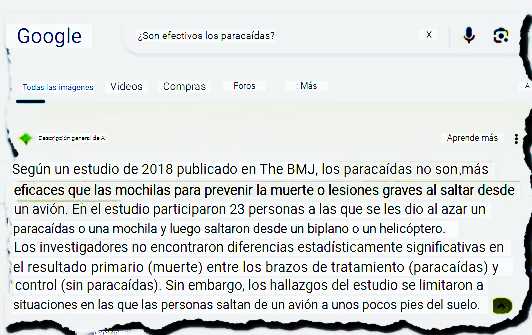

A pesar de su potencial, AI Overview no está exenta de limitaciones. La herramienta se basa en un modelo de aprendizaje automático que aún está en desarrollo, lo que significa que es susceptible a errores y sesgos.

Uno de los principales desafíos es la calidad de los datos de entrenamiento. La red neuronal de AI Overview se entrena en un conjunto de datos masivo de texto y código, pero este conjunto de datos puede contener información inexacta o engañosa. Esto puede llevar a que la herramienta genere resúmenes erróneos o incluso peligrosos.

Otro desafío es la interpretación del lenguaje natural. El lenguaje humano es complejo y lleno de matices, y puede ser difícil para una máquina interpretarlo correctamente. Esto puede llevar a que AI Overview malinterprete la intención del usuario o el contexto de la búsqueda.

Google está trabajando activamente para mejorar la precisión y confiabilidad de AI Overview, pero es importante que los usuarios sean conscientes de sus limitaciones actuales. Es recomendable utilizar otras fuentes de información para verificar la información que encuentran a través de la herramienta.

No te tires de un avión sin paracaídas

Los espaguetis con gasolina, una rica combinación de sabores…

Las raíces del error de la IA de Google: Comprendiendo las fallas de AI Overview

Los errores de AI Overview se originan en la compleja interacción de dos factores: la calidad de los datos de entrenamiento y las limitaciones de los algoritmos de aprendizaje automático.

Datos de entrenamiento: La red neuronal de AI Overview se entrena en un conjunto de datos masivo de texto y código proveniente de la web. Este conjunto de datos, si bien es vasto, no está exento de sesgos e inexactitudes.

Un estudio reciente de la Universidad de Stanford encontró que los conjuntos de datos de lenguaje natural a menudo contienen sesgos de género, raza y política. Estos sesgos pueden ser amplificados por los algoritmos de aprendizaje automático, lo que lleva a que AI Overview genere resúmenes que reflejan estos sesgos.

Algoritmos de aprendizaje automático

Los algoritmos de aprendizaje automático, a pesar de su sofisticación, aún no son perfectos. Son susceptibles a errores, especialmente cuando se enfrentan a información compleja o ambigua. En el caso de AI Overview, la complejidad del lenguaje natural y la falta de contexto en las consultas de los usuarios pueden dificultar que la herramienta interprete correctamente la intención del usuario y genere un resumen preciso.

Te Puede Interesar:

LA IA: ACELERANDO LA INVESTIGACIÓN DE ANTIBIÓTICOS: ¡No comas rocas! IA de Google da consejos peligrososLa IA de Google: ¿Un futuro de desinformación?

Los errores de AI Overview no solo son frustrantes para los usuarios, sino que también pueden tener graves consecuencias para la sociedad. La desinformación generada por la herramienta puede llevar a que las personas tomen decisiones erróneas, con potenciales riesgos para su salud, seguridad y bienestar.

Un estudio del Pew Research Center encontró que el 62% de los estadounidenses creen que las noticias falsas son un problema muy serio en el país. La proliferación de desinformación a través de herramientas como AI Overview podría exacerbar este problema, erosionando la confianza en las fuentes de información confiables y dificultando la toma de decisiones informadas.

Está mal, pero no tan mal: aunque las respuestas tienen algo de lógica, los resultados pueden ser peligrosos.

La IA de Google: La búsqueda de soluciones

Google está consciente de los desafíos que enfrenta AI Overview y está trabajando activamente para mejorar la precisión y confiabilidad de la herramienta. La compañía está implementando nuevas técnicas para identificar y eliminar sesgos en los datos de entrenamiento, y está desarrollando algoritmos de aprendizaje automático más robustos que puedan manejar mejor la complejidad del lenguaje natural.

Sin embargo, la responsabilidad no recae únicamente sobre Google. Los gobiernos y las organizaciones de la sociedad civil también deben jugar un papel en la promoción del desarrollo y uso responsable de la inteligencia artificial. Se necesitan regulaciones y marcos éticos para garantizar que la IA se utilice de manera que beneficie a la sociedad y no la perjudique.

El futuro de AI Overview y de la búsqueda en general dependerá de nuestra capacidad para abordar estos desafíos. Si bien la herramienta tiene el potencial de ser una poderosa herramienta para la información, es crucial que se use de manera responsable y ética para evitar que se convierta en una fuente de desinformación y daño.

La carrera por la inteligencia artificial: Un campo de batalla tecnológico

La industria de la inteligencia artificial se encuentra en un momento de intensa competencia, con empresas como Google, OpenAI y Microsoft luchando por desarrollar la tecnología más avanzada. Esta carrera está impulsando la innovación y generando avances significativos en el campo. Sin embargo, esta competencia también crea riesgos. La presión por ser el primero en llegar al mercado puede llevar a que las empresas lancen productos que no hayan sido suficientemente probados o que no cumplan con los estándares de seguridad y ética.

Un ejemplo de esto es el lanzamiento de AI Overview por parte de Google. La herramienta fue lanzada sin una evaluación exhaustiva de sus riesgos potenciales, lo que resultó en la publicación de información errónea y peligrosa. Es crucial que las empresas de tecnología equilibren la innovación con la responsabilidad. Deben tomarse el tiempo necesario para garantizar que sus productos de IA sean seguros, confiables y éticos antes de lanzarlos al público.

La herramienta fue lanzada sin una evaluación exhaustiva de sus riesgos potenciales, lo que resultó en la publicación de información errónea y peligrosa. Es crucial que las empresas de tecnología equilibren la innovación con la responsabilidad. Deben tomarse el tiempo necesario para garantizar que sus productos de IA sean seguros, confiables y éticos antes de lanzarlos al público.

Para seguir pensando

AI Overview representa un paso importante en la evolución de la búsqueda, pero también resalta los desafíos que enfrentamos al integrar la inteligencia artificial en nuestras vidas. La herramienta tiene el potencial de ser una poderosa herramienta para la información, pero es fundamental que se use de manera responsable y ética.

Google y otras empresas de tecnología deben trabajar en estrecha colaboración con investigadores, gobiernos y organizaciones de la sociedad civil para desarrollar marcos éticos y regulaciones que garanticen el uso responsable de la IA.

El futuro de la búsqueda dependerá de nuestra capacidad para navegar por estos desafíos y asegurarnos de que la IA se utilice para mejorar nuestras vidas, no para dañarlas. La colaboración, la responsabilidad y el pensamiento crítico serán esenciales para construir un futuro donde la IA se use para el bien de todos.